OpenAI推出Response API,集成智能体功能,费用高引争议。

12日凌晨,OpenAI 给最基础的 API 产品即 Chat Completion API 进行了升级,也就是给 Chat Completion API 添加了智能体功能,命名为 Response API。

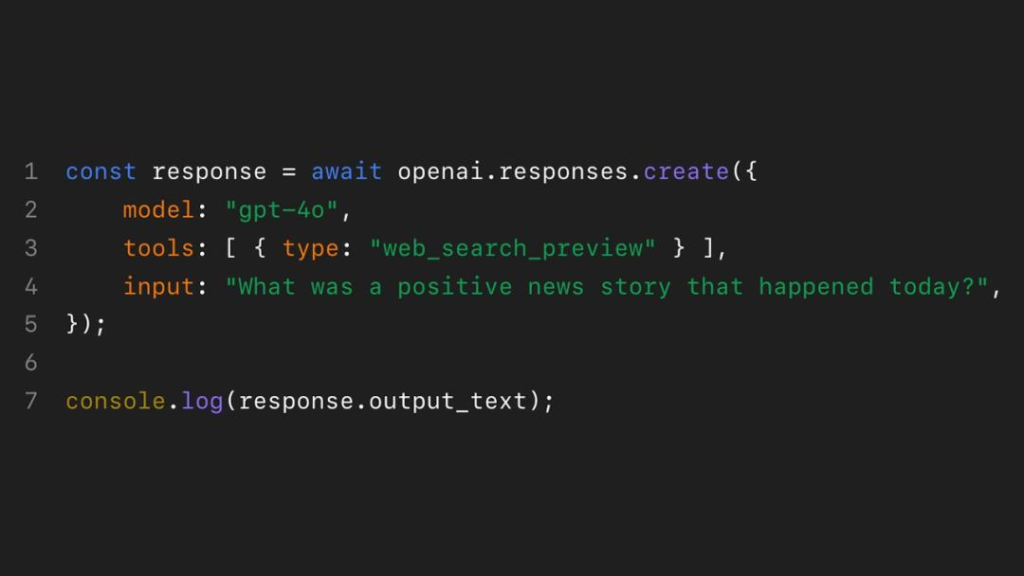

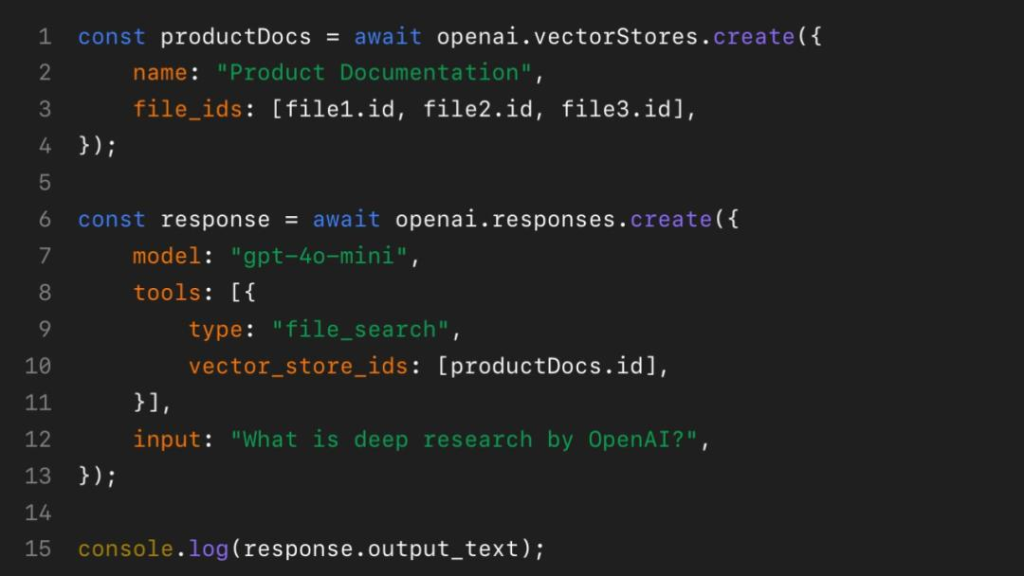

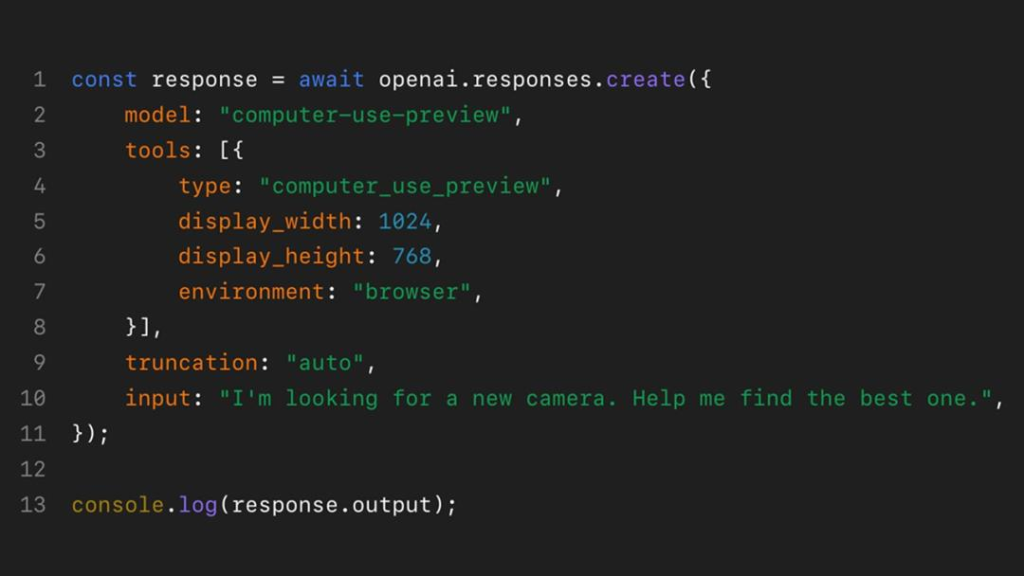

Response API 相当于让你在调用 Chat Completion API 时也可以使用联网搜索、文件搜索和 Computer Use。

想想最近爆火的 Manus 应用了什么功能,你会觉得味道比较微妙~

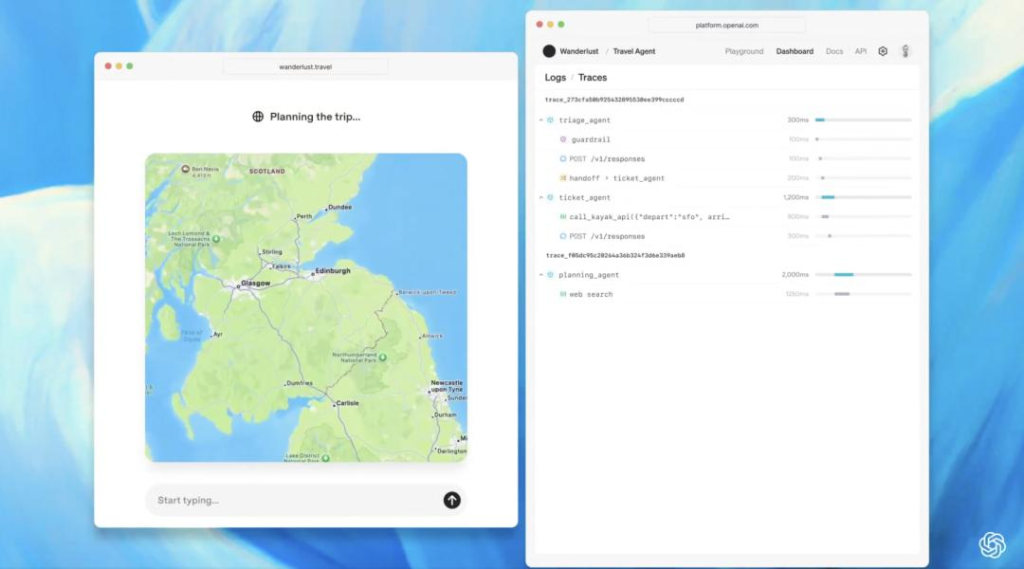

和 Response API 同时发布的还有之前发布的 Agent 框架 Swarm 的升级版,即OpenAI Agents SDK,主要的功能是智能体工作流的编排,包括了单智能体和多智能体。

Response API 可以算是 Chat Completion API 与 Assistant API 的结合体,从 Agent 构建的角度来看,使用更加简便,其声称 “ 只需要一次 Response API,就能够使用多个工具和模型论次来解决复杂任务。”

Response API 可以作为一个统一接口,将 OpenAI 的模型和内置工具集成到应用中,并能轻易实现数据存储以及智能体的性能跟踪、评估,OpenAI 还承诺:“ 不会默认使用用户的业务数据来训练我们的模型。”

至于原来的 Chat Completion API,也可以继续使用,之后更新的新模型也会继续支持,这对于只需要支持简单聊天应用的开发者来说倒是好消息,不需要花费大功夫迁移至 Response API 。

当然,Response API 已经完全包含了 Chat Completion API 的所有功能,如果你是从头开始开发,可以直接从 Response API 用起。

至于 Assistant API,之后 OpenAI 将在 Response API 完成了对 Assistant API 的功能继承之后( 比如本次很遗憾还没加上的 Code Interpreter,以及Assistant、Thread 等 ),就会在 2026 年中期将 Assistant API 完全弃用,开发者们可以做好准备开始迁移了。

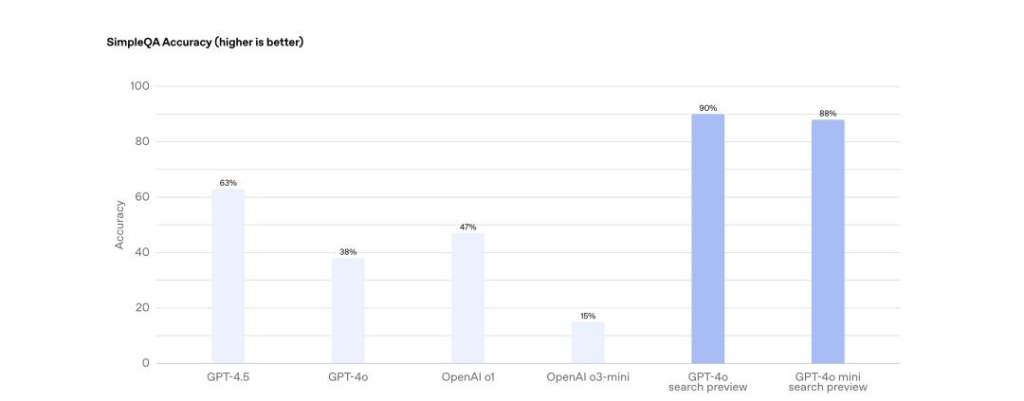

网络搜索工具基于 GPT-4o 和 GPT-4o-mini,在基准测试 SimpleQA上,GPT-4o search preview 和 GPT-4o mini search preview 获得了 90% 和 88% 的分数,远超 OpenAI 其它没有调用搜索的基础模型。

费用方面,GPT-4o search preview 和 GPT-4o mini search preview 的定价分别是 30 美元每千次查询和 25 美元每千次查询。

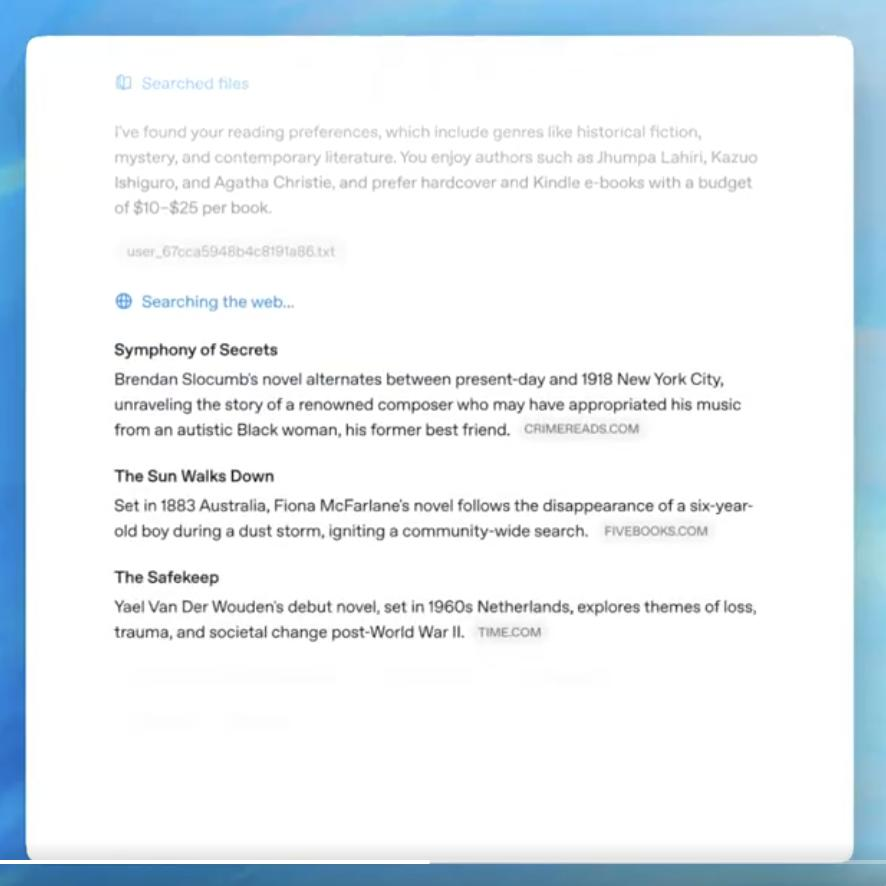

文件搜索工具和 Assistant API 中的类似,相比于 Assistant API,增加了元数据过滤、直接搜索端点( 可直接搜索向量存储 )等新功能。

费用方面,每千次查询是 2.50 美元,文件存储则是 0.10 美元/GB/天,首 GB 免费。

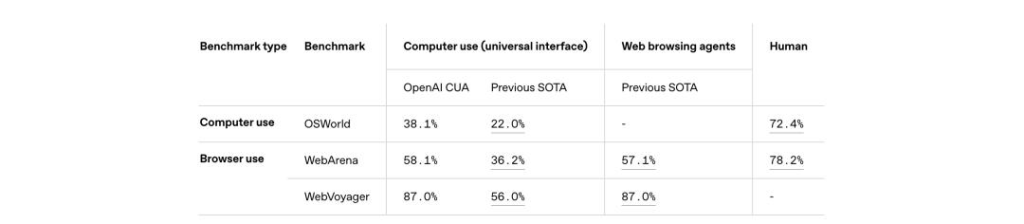

Computer Use 工具和之前发布的 Operator 一样使用了 Computer-Using Agent( CUA )模型。基准测试方面,该模型在 OSWorld 的全 Computer Use 任务上达到 38.1% 成功率,在 WebArena 上达到 58.1% 成功率,在 WebVoyager 的基于 Web 的交互任务上达到 87% 成功率,创下了新的 SOTA 记录。

OpenAI 表示,此次通过 API 使用 Computer Use,相当于将 Operator 的功能扩展到本地操作系统,会引入新的风险,尽管进行了额外的安全评估和红队测试,结合其在 OSWorld 上仍然远不够好的表现,官方建议使用时进行人工监督。

费用方面,Computer Use 的每百万 token 输入花费 3 美元,每百万 token 输出花费 12 美元。

按照 OpenAI 的表态,Response API 代表了他们未来构建智能体的路线选择。

OpenAI Agents SDK 建立在 Swarm 基础之上,Swarm 基于 Chat Completion API,相比于 Assistant API,有更好的透明度,能够进行细粒度地控制上下文、执行步骤和工具调用。

具体的改进包括:

- 智能体:易于配置的LLM,具有清晰的指令和内置工具;

- 交接:智能体之间的智能控制转移;

- 防护机制:可配置的输入输出验证的安全检查;

- 追踪和可视化:通过可视化智能体脂性轨迹来调试和优化性能;

在未来,OpenAI 可能将 Agents SDK 开源。

据 OpenAI 的 Atty Eleti( Response API 的开发者之一 )分享,Response API 开发初衷是基于当下多模态输入输出、思维链推理以及智能体工作流的趋势,Chat Complete API 将逐渐无法适应这样的发展,而 Assistant API 的使用又过于复杂,后台处理方式意味着其速度必然是很慢的。

相比于 Chat Completion API,Response API 会存储所有 Response,无需重复输入上下文,只需要使用 “ previous_response_id ” 就可以继续对话。

Response API 的响应结构更加复杂,用概念 item 表示,代表了用户输入或模型输出的多态对象,其中可以包含消息、推理、函数调用、web 搜索调用等。

尽管有那么多的改进和便捷的设计,Response API 就香了吗?

在过去由于 Chat Completion API 的限制,开发者只能用Assistant API实现文件搜索等功能,而 Assistant API 在使用中有太多槽点,比如使用复杂、响应速度慢、缺少 Webhook 设置、上下文编辑困难、token 数容易暴涨( 添加的文档也会在多轮聊天中重复调用并消耗 token )、RAG 文件存储太昂贵等等。

这一次,Response API 能在多大程度上改进 Assistant API 糟糕的用户体验还是一个未知数。

而基于 Reddit、Hacker News 上用户的反馈,OpenAI 本次的发布并没有引发特别大的惊喜,反而吐槽更多。

比如网络搜索的费用,有网友表示,这可比自己配置 Google search api( 可能只需 1-1.5 美元 )贵太多了。

OpenAI 的目的是想用一套工具,把自己过去的已有成果统统整合起来,提高产品易用性,并提供全套监控和衡量工具,让开发者更加依赖这个生态,尤其是数据存储功能的支持,如果开发者入坑了,生态依赖会更加强。

但这终究是一种傻瓜式的产品,更适合初级开发者,对于那些需要有更多自定义和复杂功能的开发者而言,这样的产品其实没有太大的吸引力。

尤其是对于智能体的开发,目前智能体的发展尚处于早期阶段,还没有太多可以标准化的东西,或者说社区的探索还没有出现大量重复造轮子的工作,那么对智能体进行抽象的必要性就很小。把语言模型单独作为一个黑盒存在,然后去构建面向场景的工具和软件才是最好的方式,而不是在它之上嵌套过多的 LLM 抽象。“ LLM应该是一个应用中最无聊的存在。”

简言之:小白狂喜,老手无感 —— 鸡肋。

在设计能征服开发老手的产品上,OpenAI 还得跟 Anthropic 多学学。

最后,如果你需要付费使用ChatGPT、Grok、Gemini、Claude等AI工具,可选择开通虚拟信用卡进行付款。4399Pay是一家专门提供国际虚拟信用卡的平台,无限开卡且免KYC;有兴趣的朋友可以添加客服TG(@dabai717)进行了解。

参考资料:

https://openai.com/index/new-tools-for-building-agents

https://news.ycombinator.com/item?id=43334644